Еще в прошлом году, 25 декабря, OpenWebUI обновился до версии 0.5.0 и один из лучших интерфейса работы с моделями в Ollama начал новый этап своей жизни. Давайте рассмотрим, что нового появилось за 1.5 месяца разработки и что теперь он предлагает в версии 0.5.12.

-

Асинхронные чаты с нотификациями. Теперь вы можете начать чат, перейти в другие чаты чтобы посмотреть какую то информацию и вернуться назад и ничего не потерять, как было раньше. Работа с моделью ведется в асинхронном режиме и когда она закончит выдачу информации вы получите нотификацию об этом.

-

Swagger документация OpenWebUI доступна теперь оффлайн и не требует подключения к сети интернет. Не забудьте также про один момент: в docker образе OpenWebUI в строке запуска необходимо передавать переменную -e ENV='dev' иначе он запустится в prod режиме и без доступа к API документации.

-

Поддержка Kokoro-JS TTS. Пока только для английского и британского английского, но работает прямо в вашем браузере с хорошим качеством озвучки. Ждем русские голоса в моделях.

AI-платформа: предустановленные языковые LLM-модели на высокопроизводительных серверах с GPU-картами.

Арендуйте высокопроизводительный сервер с GPU картой с предустановленными лучшими LLM-моделями:

- DeepSeek-r1-14b

- Gemma-2-27b-it

- Llama-3.3-70B

- Phi-4-14b

🔶 Карты NVIDIA RTX4090 🔶 Почасовая оплата 🔶 Скидки до 30%

-

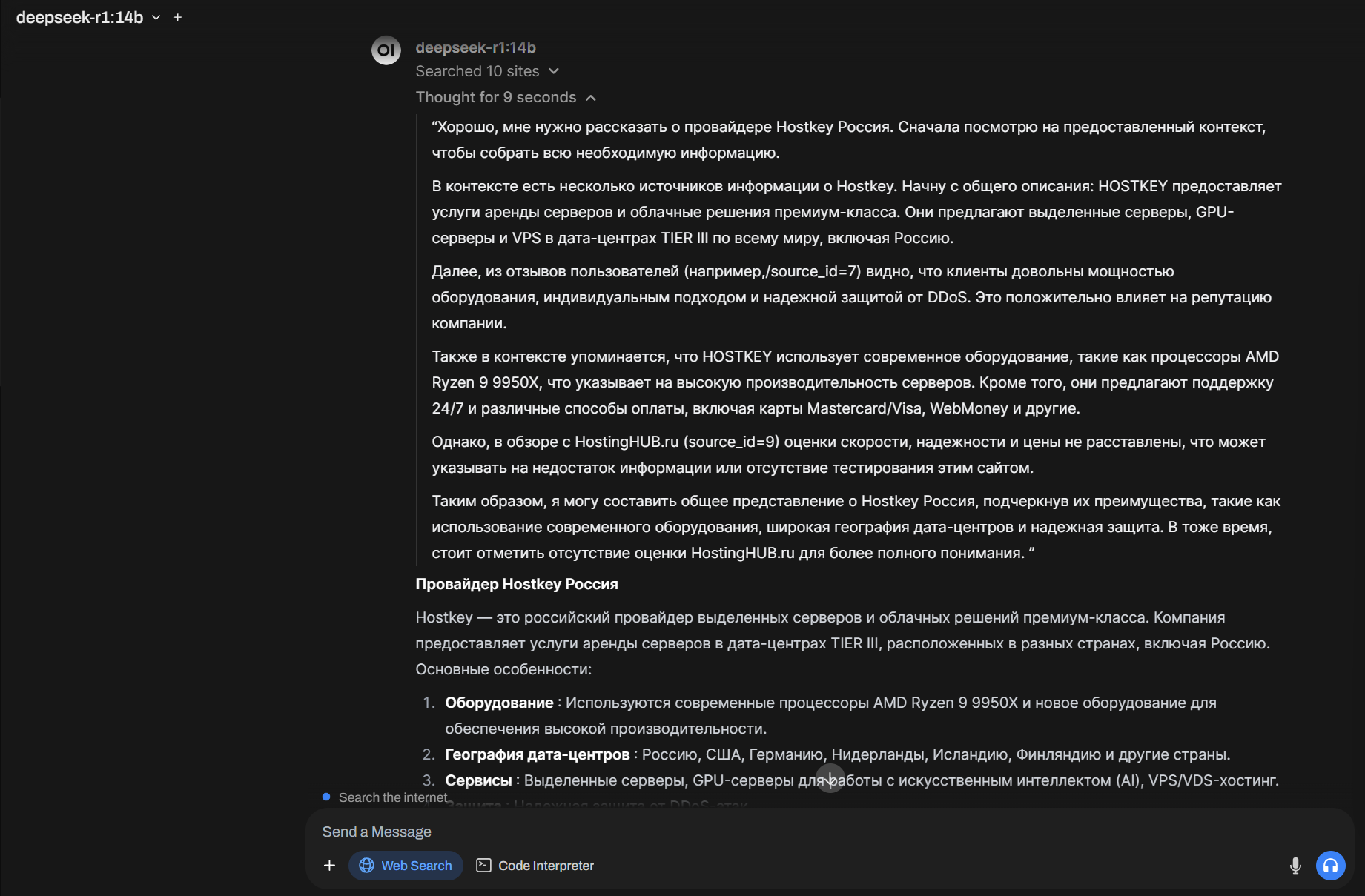

Появился режим Code Interpreter, которые позволяет запускать код через Pyoide и Jupyter и улучшать результаты вывода. Включается в Settings - Admin Settings - Conde Interpreter, доступ к Jupiter идет через внешний сервер с ним.

-

Поддержка “думающих” моделей и вывода размышления в отдельных вкладках. Теперь можно поставить модель типа DeepSeek-R1 и посмотреть, как модель интерпретирует промт, “размышляя” над ним.

-

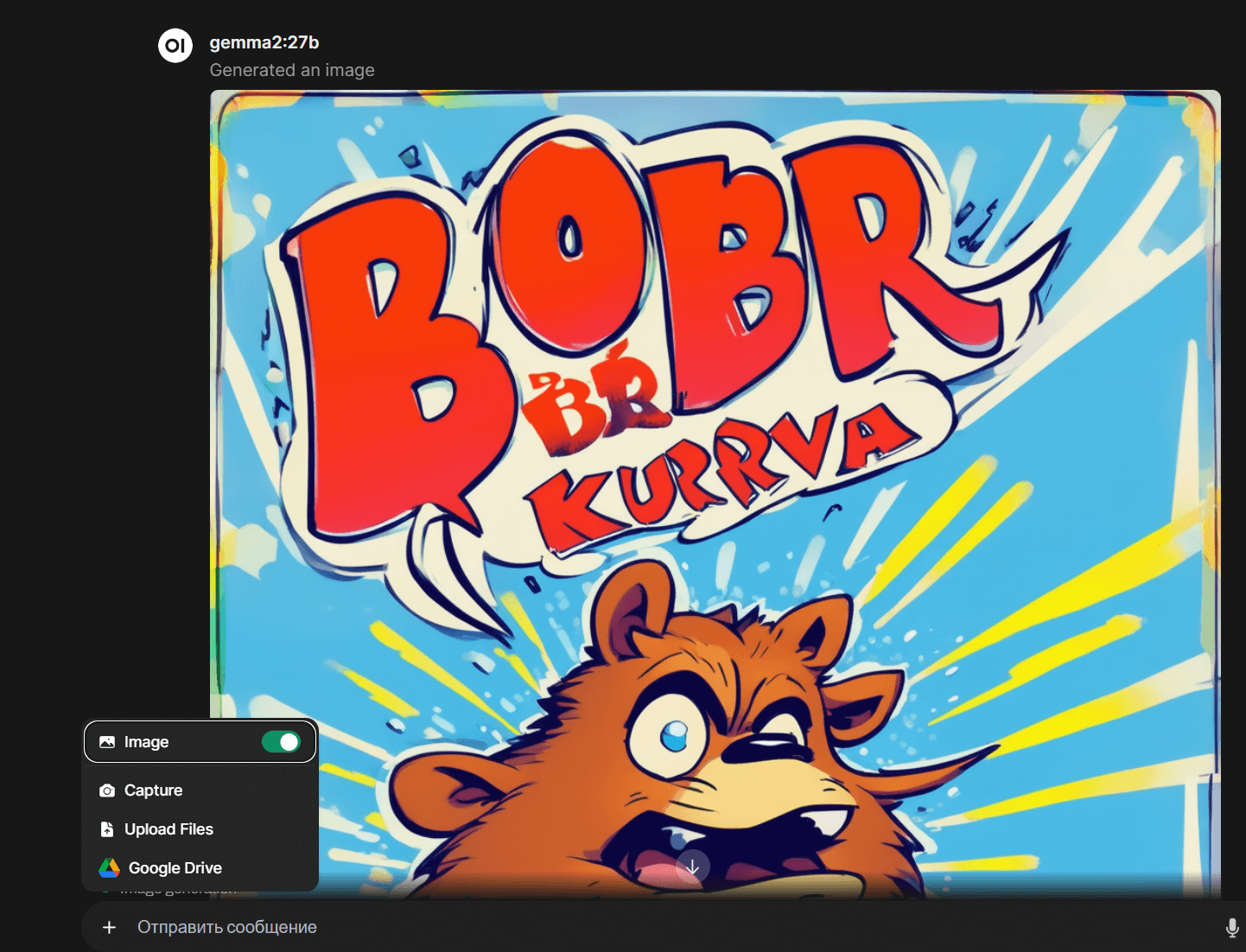

Генерацию изображений можно делать (при подключенном сервисе ComfyUI, Automatic1111 или другом сервисе) прямо из промта ввода, достаточно включить переключатель Image в меню + слева промта.

-

Документы теперь можно подгружать не только в виде файлов, но и через Google Drive. К сожалению удобный способ щелкнуть на пункт меню и выбрать аккаунт для авторизации доступа не получится, нужно заводить OAuth клиента, проект в Google, получать ключи доступа к API и передавать переменные в инстанс OpenWebUI при записи. То же самое с доступом к S3 хранилищам. Ждем удобного решения, понятного большинству пользователей.

-

Веб-поиск можно включить на постоянной основе, чтобы получать релевантные результаты, как это сделано в том же ChatGPT. Делается это в Settings - Interface в пункте Allows users to enable Web Search by default.

-

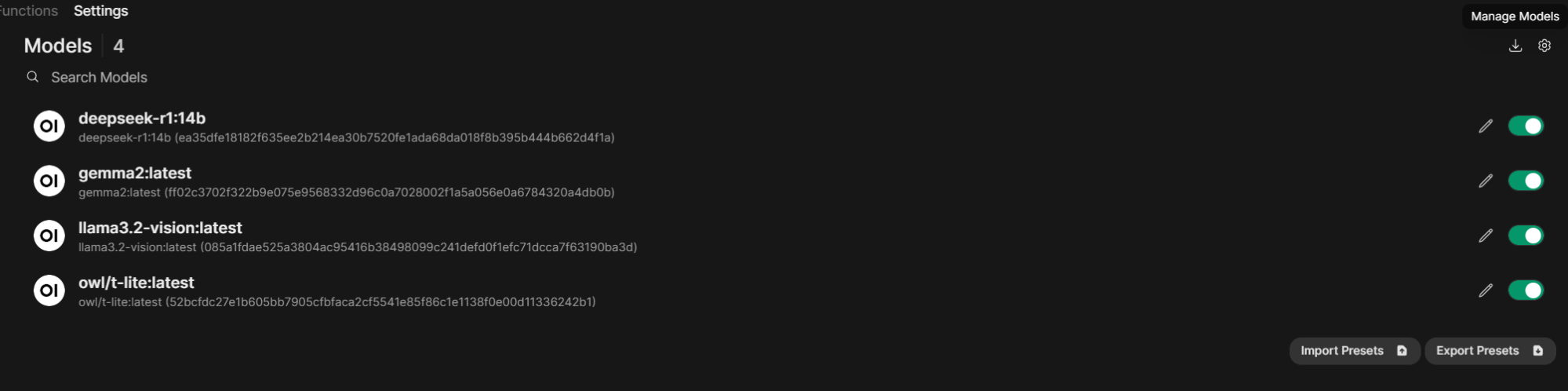

Переработанный пункт меню работы с моделями. Теперь можно включать и выключать модели и гибко их настраивать. Кто потерял пункт удаления моделей, то он теперь зачем-то засунут под маленький значок скачивания Manage Models в правом верхнем углу раздела. Нажав на него получите привычное окно добавления и удаления моделей в Ollama.

-

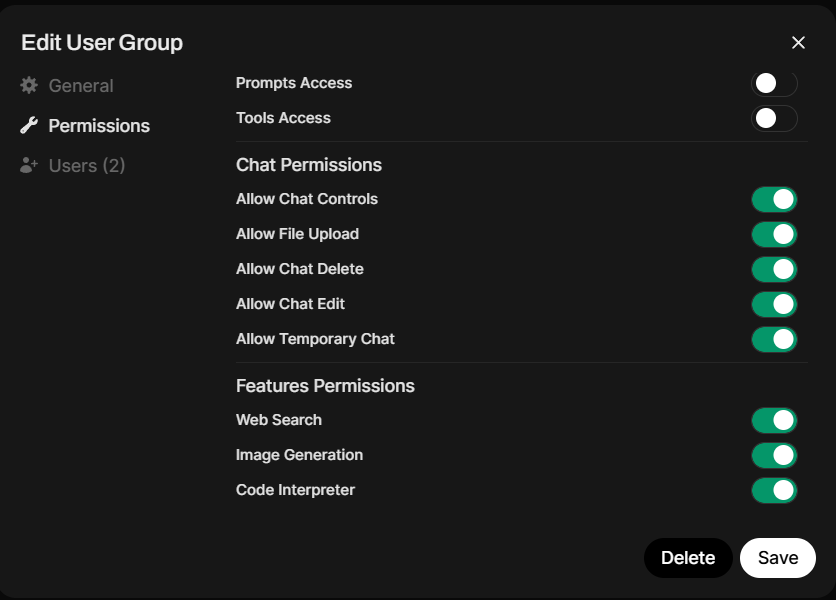

Гибкая настройка прав для моделей и пользователей. Теперь нужно пользователей заводить в группы, а уже группам давать доступ к моделям и настраивать доступ к функция OpenWebUI, разрешив или запретив им те или иные действия как в Workspace, так и с чатами.

-

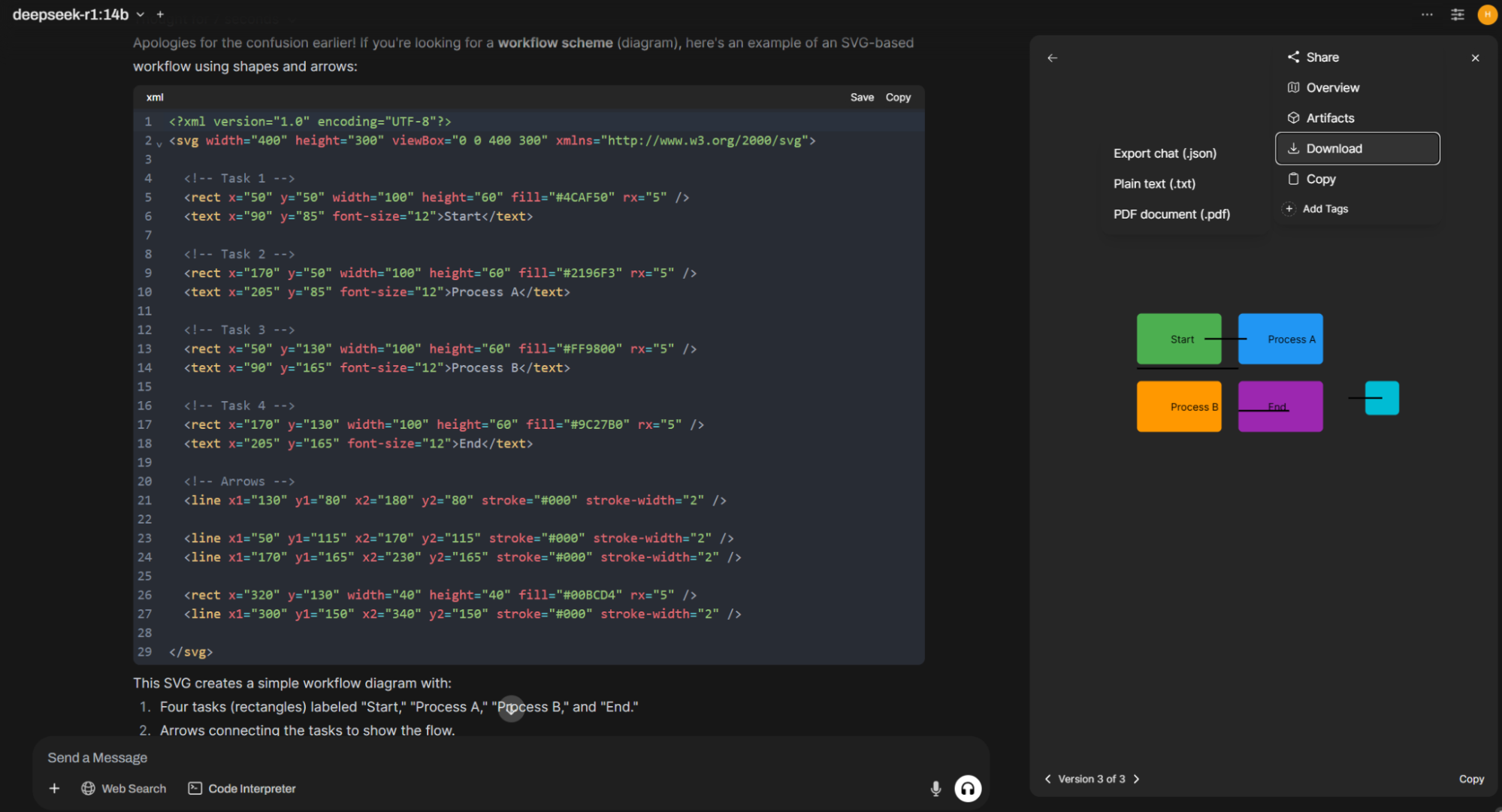

Новые меню дополнительных функций для чата, вызываемое по нажатию на три точки в правом верхнем углу. Позволяет поделиться чатом и совместно работать над ним. Также можно посмотреть схему чатов (Overview), вывести окно вывода HTML и SVG генерации в реальном времени (раздел Artifacts), чтобы сразу видеть изменения, скачать весь чат в json, txt или PDF, скопировать его в буфер обмена или добавить теги для последующего поиска.

-

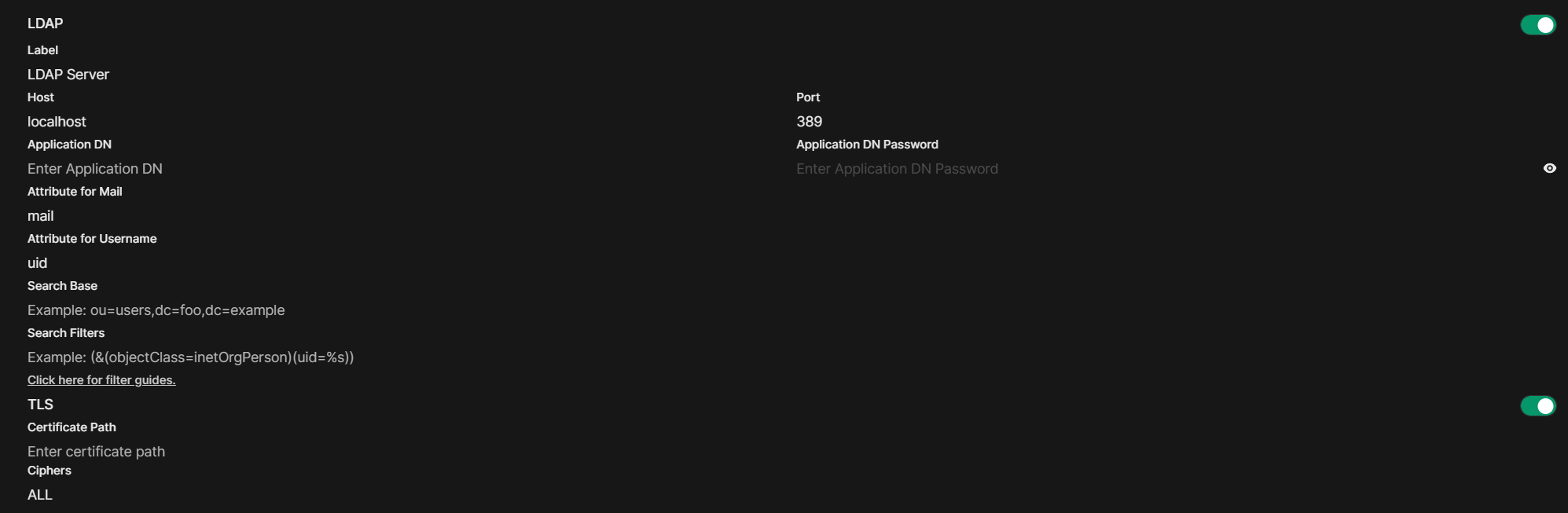

Авторизация через LDAP. Если вы используете OpenWebUI в организации, то просто подключите его к вашему серверу авторизации, задав нужные атрибуты для почты и имени пользователя. В группы пользователей увы придется распределять вручную.

-

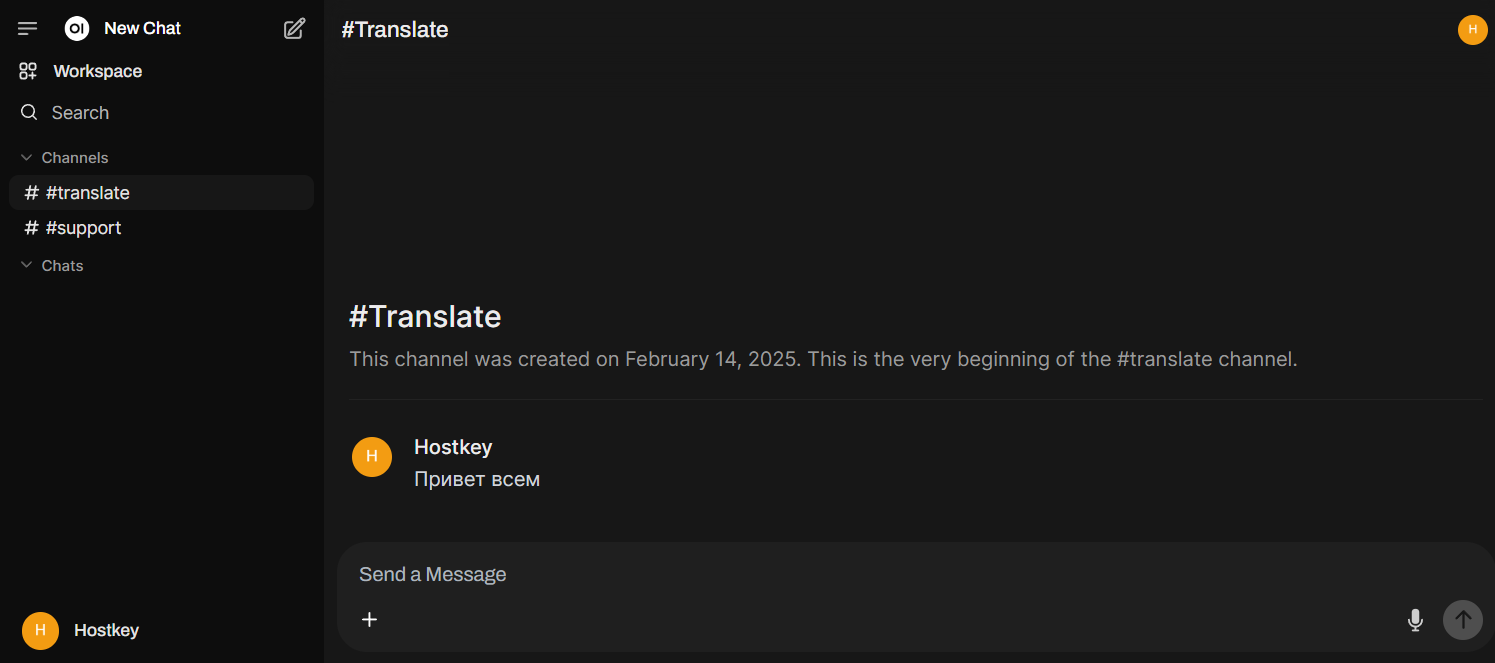

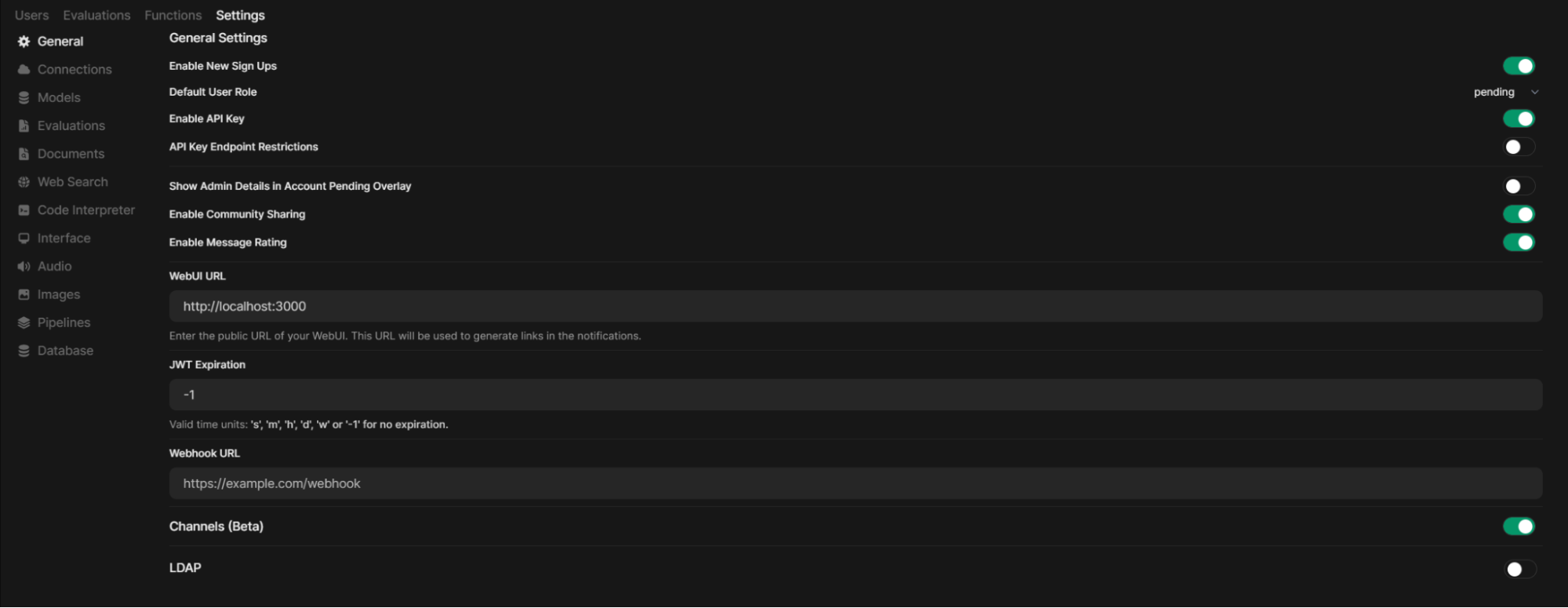

Каналы (Channels). Это чаты внутри OpenWebUI между пользователями. После создания, их видят все пользователи или пользователи определенных групп и в них они могут общаться между собой. Для доступа к этой функции необходимо включить их в Settings - Admin Settings - General.

И еще много других улучшений, включая поддержку OAuth, запуска tools и functions самими моделями, мелких изменений в UI, улучшения API, поддержки TTS через решения от Microsoft или модели MCU-Arctic и т.п. Поэтому если хотите быть на “острие” нововведений не игнорируйте оповещения о выходе новых версий OpenWebUI и обновляйтесь. Хотя мы рекомендуем делать это с задержкой на несколько дней, так как обычно крупное обновление потом получает кучу мелких исправлений в течении 2-3 дней после.